DialogueRNN

代码运行

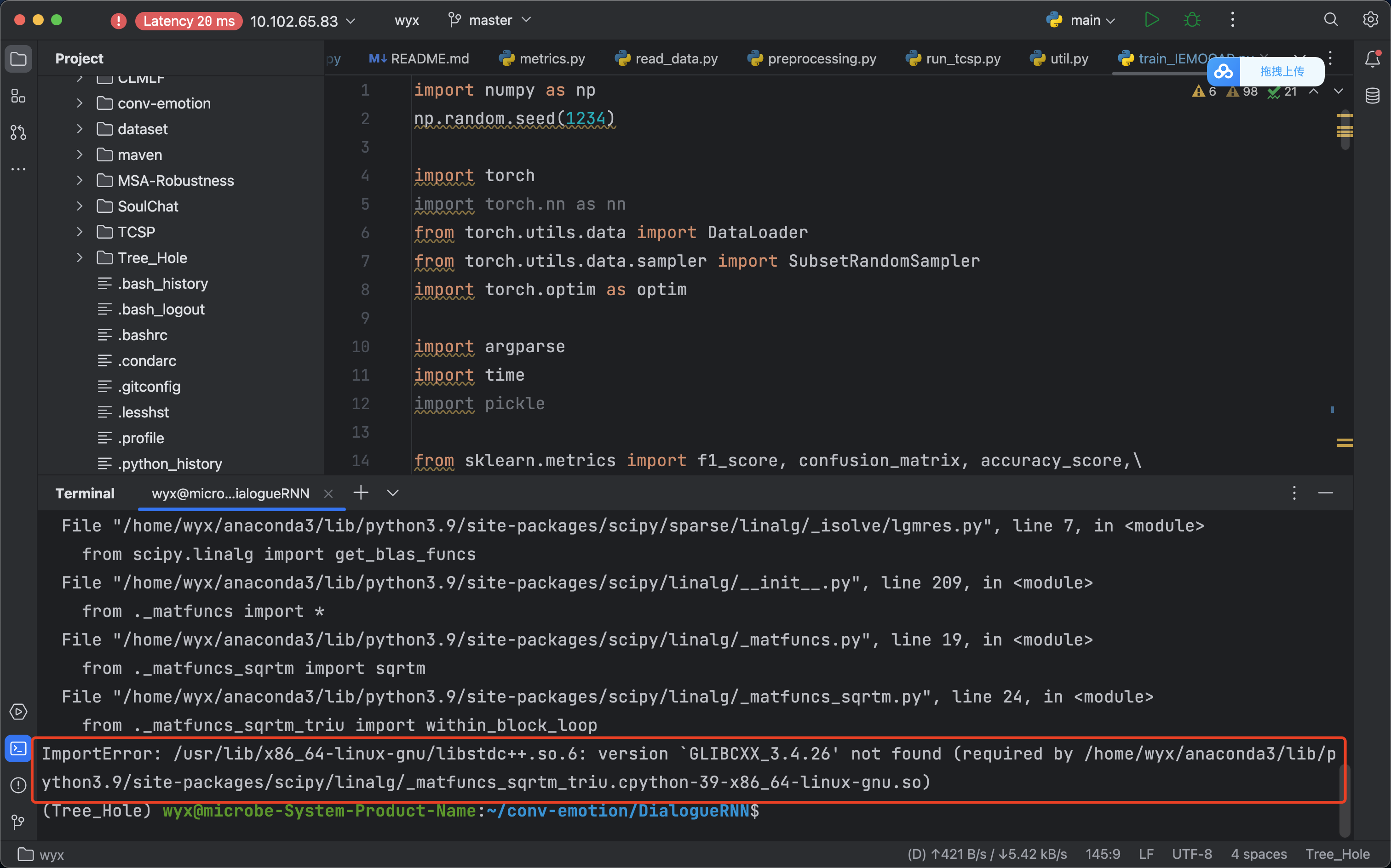

遇到的问题

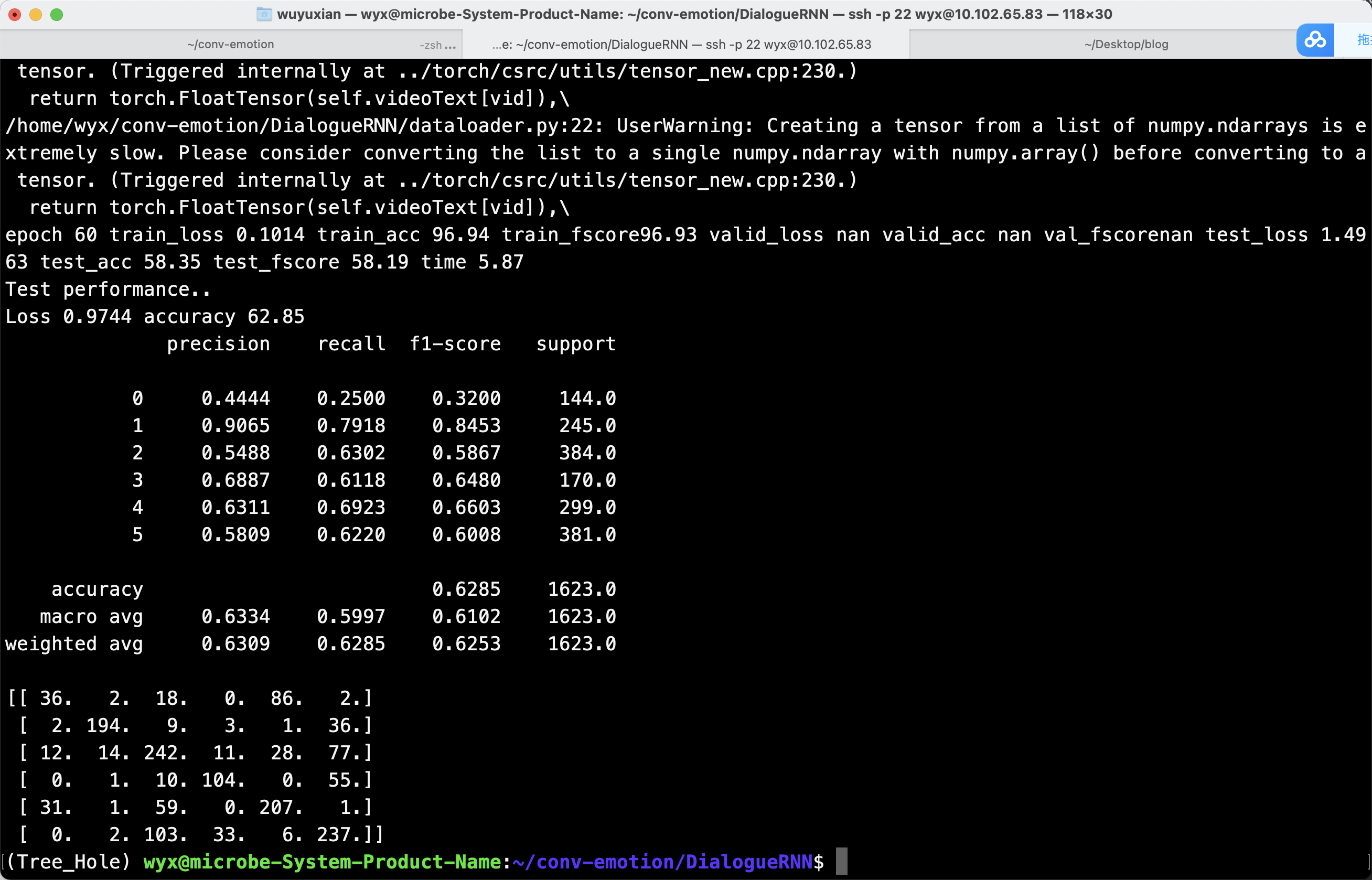

运行结果

掩码的作用

掩码(Mask)在深度学习中起着非常重要的作用,特别是在序列数据处理中。它用于在处理可变长度序列时对不同长度的序列进行对齐或者忽略填充部分,以便模型能够处理不同长度的输入序列。

门控循环单元(GRU)

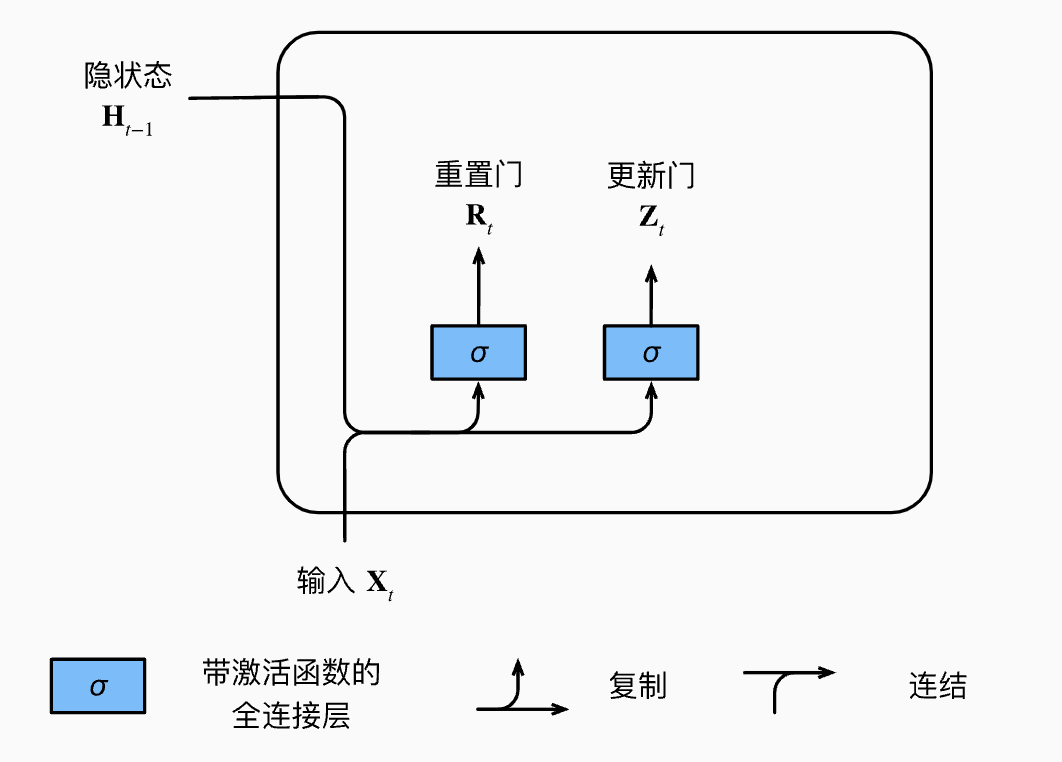

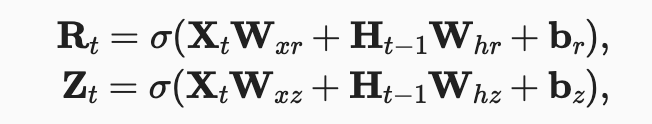

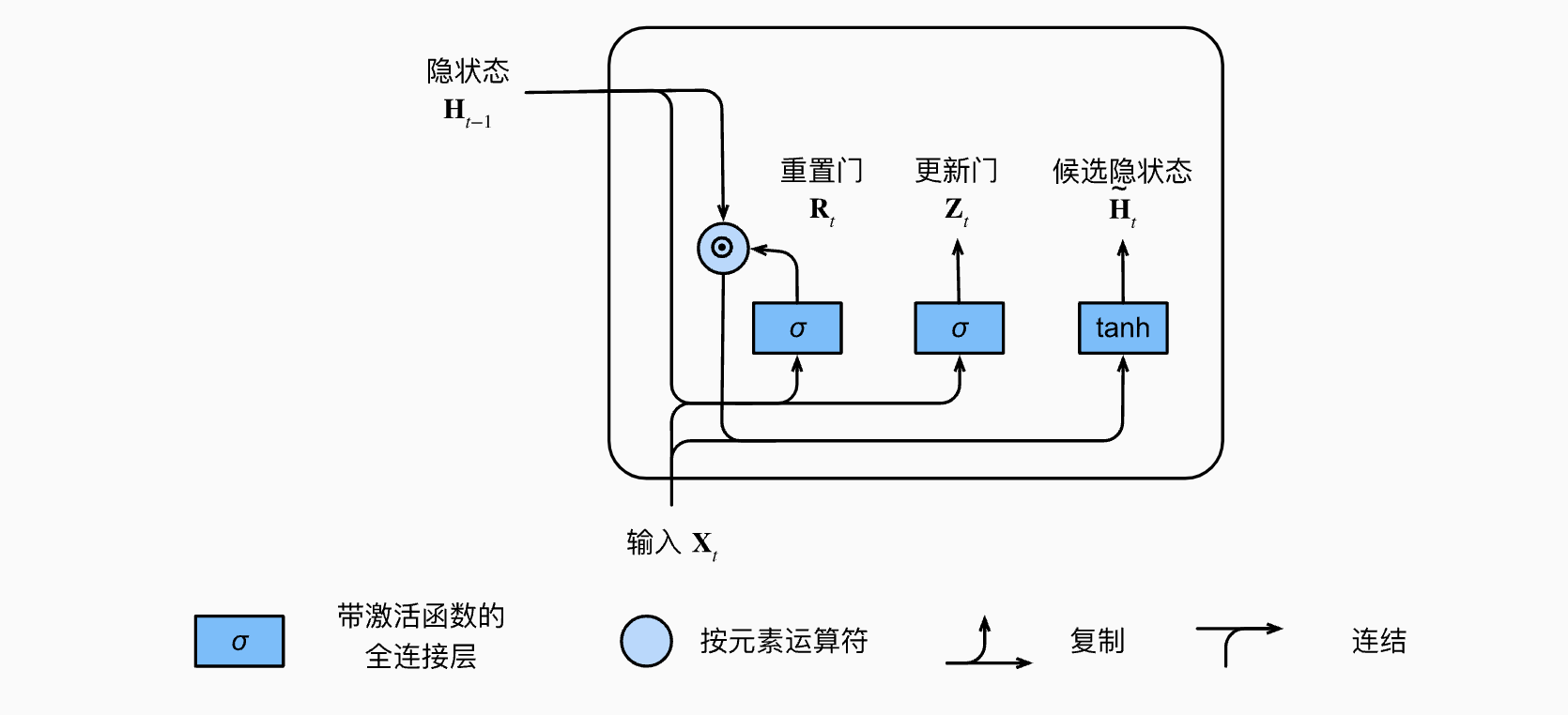

1.重置门和更新门

输入小批量的$X_t = \mathbb{R}^{n\times d}$,上一个时间不多隐状态是$H_{t-1}\in \mathbb{R}^{n\times h}$,重置门$R_t = \in \mathbb{R}^{n\times h}$和更新门$Z_t = \in \mathbb{R}^{n\times h}$的计算公式如下:

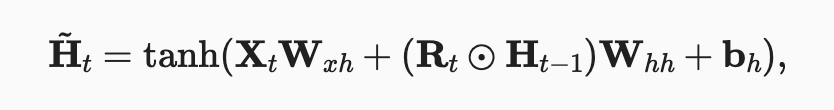

2.候选隐状态

时间步t的候选隐状态$\widetilde{H_t}\in \mathbb{R^{n\times h}}$

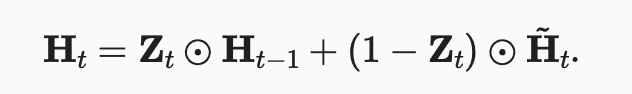

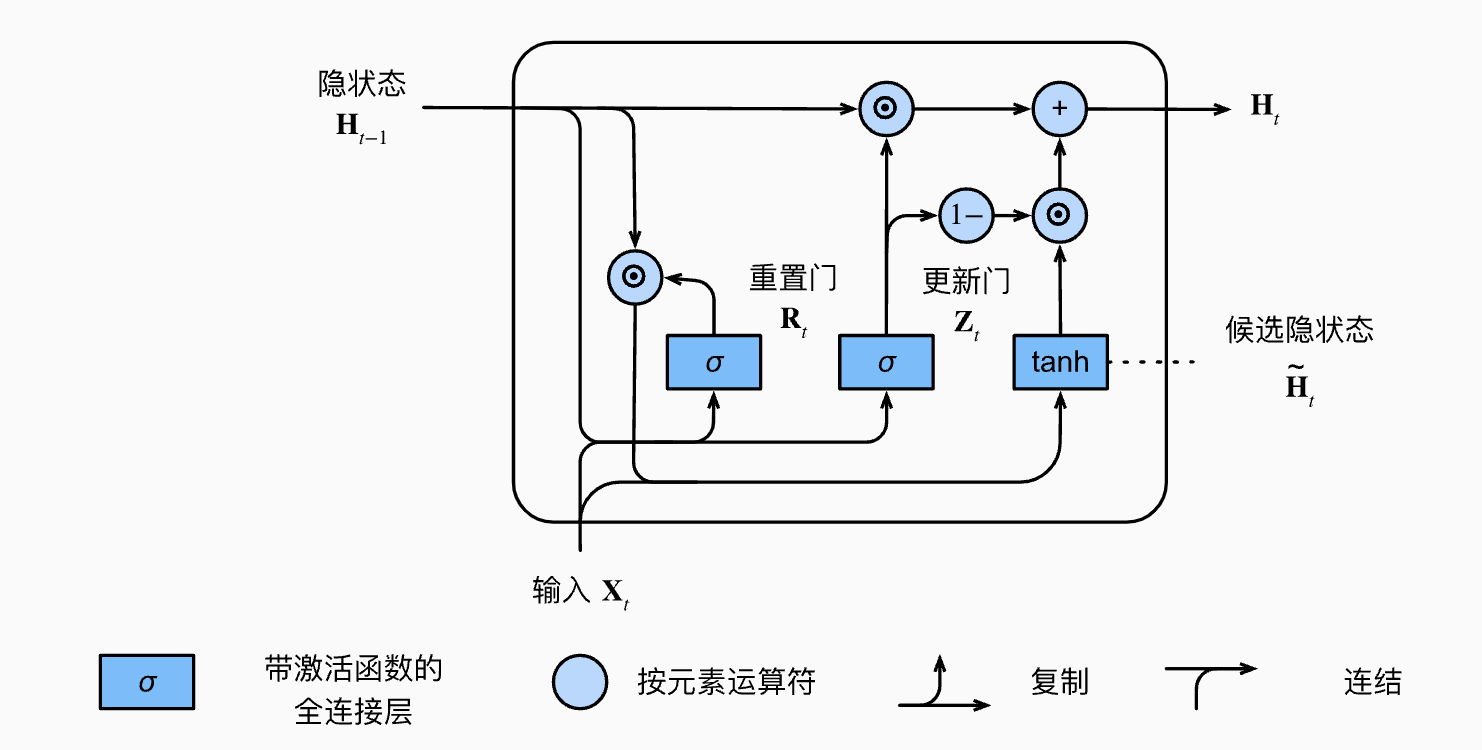

3.隐状态

上述的计算结果只是候选隐状态,我们仍然需要结合更新门$Z_t$的效果。 这一步确定新的隐状态$H_t\in \mathbb{R^{n\times h}}$ 在多大程度上来自旧的状态$H_{t-1}$和新的候选状态$\widetilde{H_t}$。 更新门$Z_t$仅需要在$H_{t-1}$和$\widetilde{H_ t}$之间进行按元素的凸组合就可以实现这个目标。 这就得出了门控循环单元的最终更新公式:

- 重置门捕获短期依赖

- 更新门捕获长期依赖

DialogueRNN

http://example.com/2023/07/29/DialogueRNN/